AI 従業員モデルの設定

既定では、AI 従業員はシステム内の有効な LLM サービスとモデルをすべて使用できます。管理者は特定の従業員に専用モデル設定を有効化し、使用可能モデルを制限できます。

前提条件

- AI Employees プラグインが有効化されています。

- 少なくとも 1 つの LLM サービスが設定されています。

- 対象の AI 従業員が有効化されています。

LLM サービスの設定は次を参照してください LLM サービスの設定.

入口

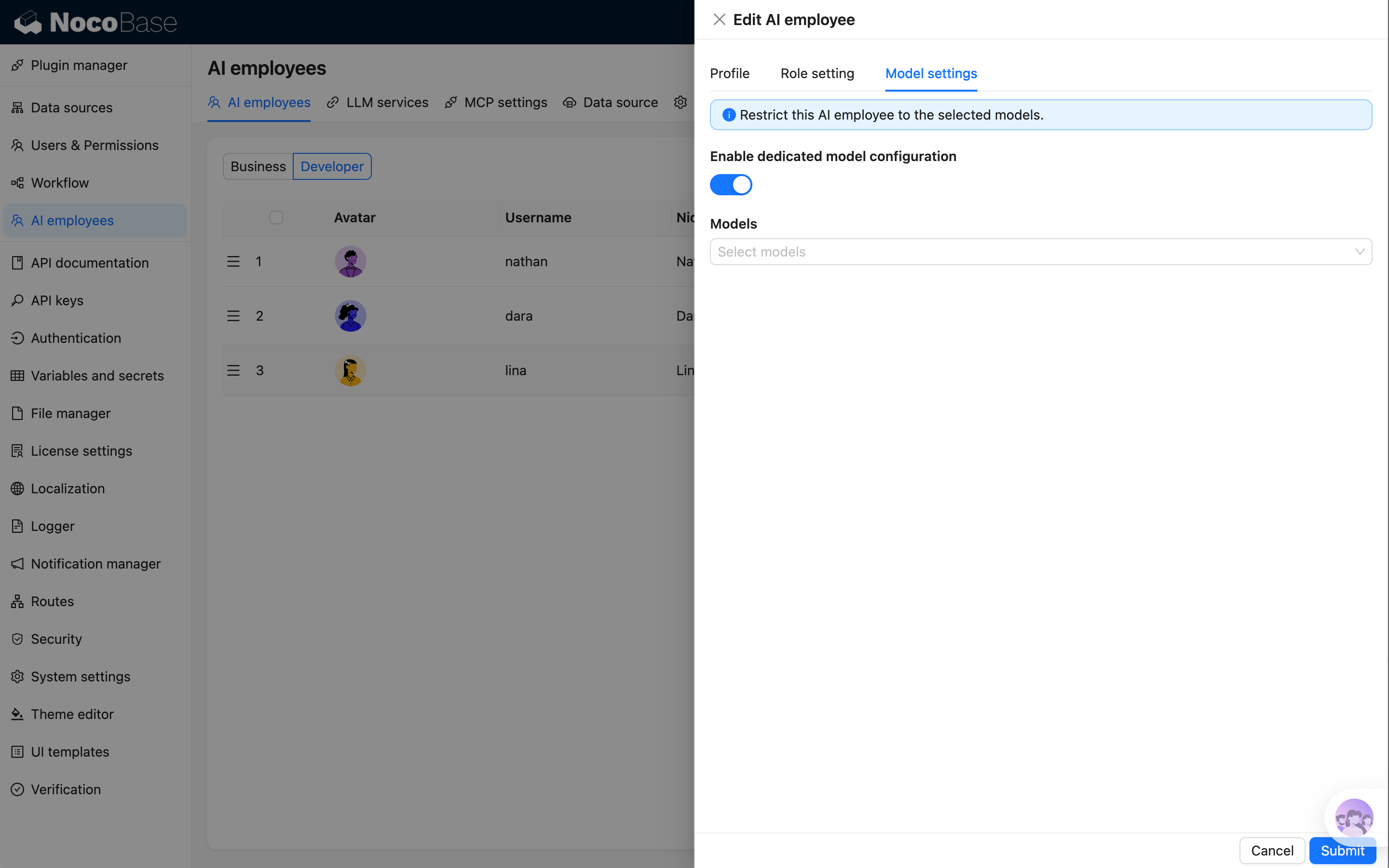

System Settings -> AI Employees -> AI employees に移動し、設定する AI 従業員を開いて Model settings に切り替えます。

専用モデル設定を有効にする

Enable dedicated model configuration を有効化した後、Models で許可するモデルを選択します。

- チャットのモデル切替には選択済みモデルのみ表示されます。

- ショートカットタスクとワークフローノードは選択済みモデルのみ使用できます。

ヒント

専用モデル設定が有効でもモデルが選択されていない場合、利用可能なモデルを解決できません。

専用モデル設定を無効にする

無効化すると、既定のモデルルールに戻ります。

- 有効なすべての LLM モデルを使用できます。

- 手動選択がない場合、シ�ステムはグローバル既定モデルを使用します。

モデル解決ルール

タスク実行時、最終モデルは次の順序で解決されます。

- 専用モデル設定が有効な場合、まず選択済みモデルの範囲内で解決します。

- リクエストでモデルが指定され、そのモデルが許可されている場合は、そのモデルを使用します。

- 指定されたモデルが許可されていない場合、最初の許可済みモデルを使用します。

- 専用モデル設定が有効でない場合、リクエストで指定されたモデルを優先します。

- モデルが指定されていない場合、グローバル既定モデルを使用します。

推奨事項

- ローカルデプロイができない場合も、一般チャットモデルではなく翻訳専用モデルを選択してください。

- モデル能力に応じて並行数を調整し、スループット、応答時間、コストを制御できます。

FAQ

モデル一覧が空なのはなぜですか?

通常、LLM サービス未設定またはモデル未有効化が原因です。Enabled Models を確認してください。

ユーザーが他のモデルに切り替えられないのはなぜですか?

専用設定が有効な場合、選択済みモデル範囲のみ利用できます。

どの項目に影響しますか?

新しいチャット、ショートカットタスク、ワークフロー AI 従業員ノード、プラグイン組み込みタスクに影響します。履歴メッセージは再生成されません。