AI翻訳通知

このドキュメントはAIによって翻訳されました。正確な情報については英語版をご参照ください。

LLM サービスの設定

AI 従業員を使用する前に、まず利用可能な LLM サービスを設定する必要があります。

現在、OpenAI、Gemini、Claude、DeepSeek、Qwen、Kimi、および Ollama のローカルモデルをサポートしています。

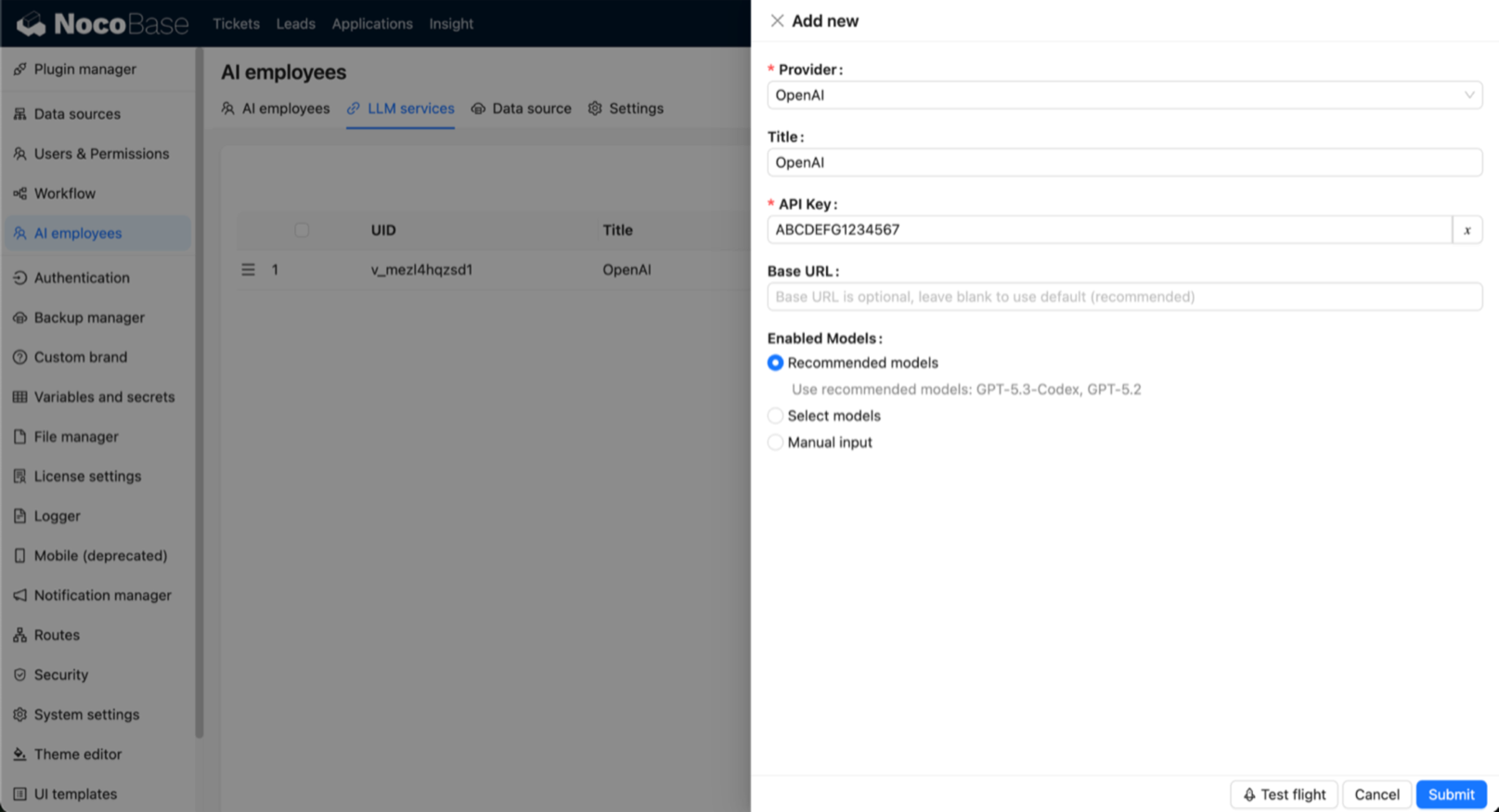

サービスの新規作成

システム設定 -> AI 従業員 -> LLM サービス に移動します。

Add Newをクリックして、新規作成ダイアログを開きます。Providerを選択します。Title、API Key、Base URL(任意)を入力します。Enabled Modelsを設定します:Recommended models:公式の推奨モデルを使用します。Select models:プロバイダーから返されたリストから選択します。Manual input:モデル ID と表示名を手動で入力します。

Submitをクリックして保存します。

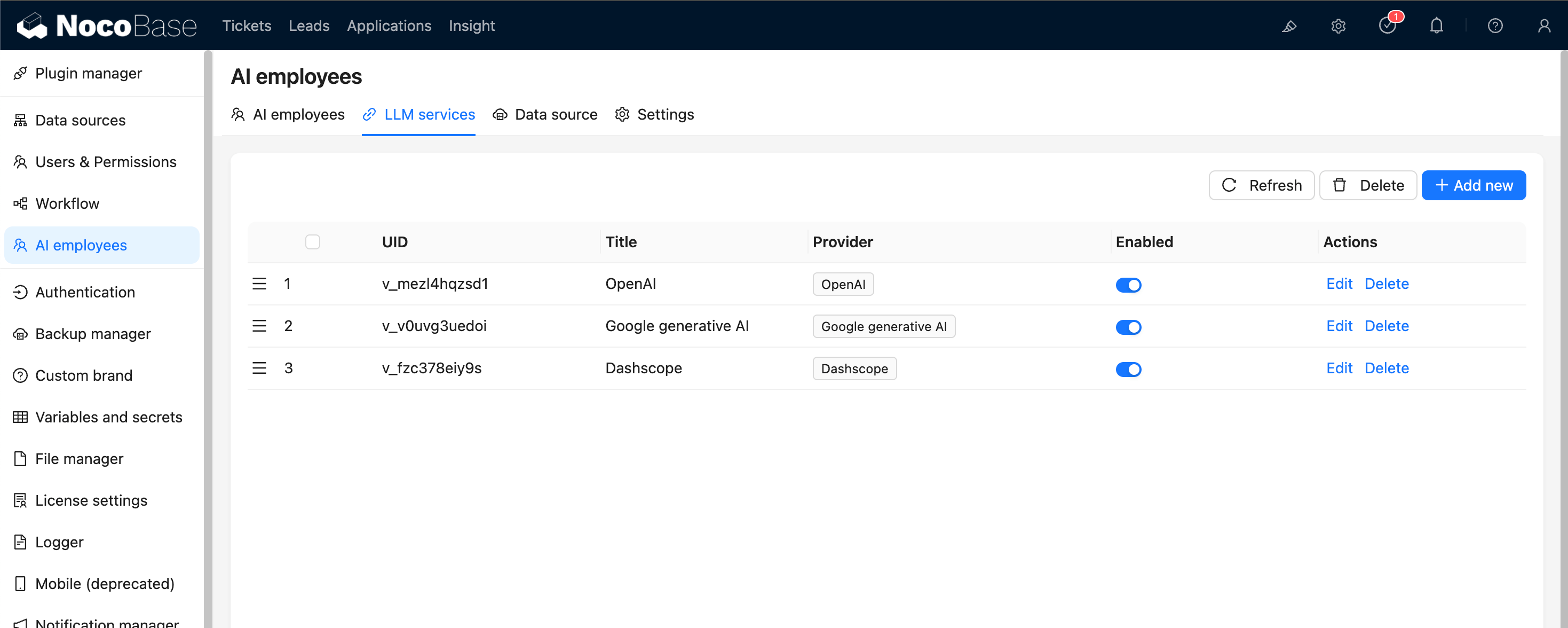

サービスの有効化と並べ替え

LLM サービスリストでは、以下の操作が可能です:

Enabledスイッチを使用して、サービスの有効化/無効化を切り替えます。- ドラ��ッグ&ドロップでサービスの順序を並べ替えます(モデルの表示順に影響します)。

可用性テスト

サービス設定ダイアログの下部にある Test flight を使用して、サービスとモデルの可用性をテストします。

実際の業務で使用する前に、まずテストを行うことをお勧めします。