配置 AI 员工模型

AI 员工社区版+默认情况下,AI 员工可以使用系统中已启用的所有 LLM 服务和模型。管理员也可以为某个 AI 员工启用单独的模型配置,限制该员工只能使用指定模型。

该配置适用于需要稳定模型能力、成本控制或专项模型的场景。例如 Lina 可以固定使用翻译模型,Viz 可以限制在更擅长数据分析的模型范围内。

前置条件

配置 AI 员工模型前,需要先完成以下准备:

- 已启用 AI 员工 插件。

- 已配置至少一个 LLM 服务。

- LLM 服务中已配置可用的

Enabled Models。 - 目标 AI 员工已启用。

LLM 服务配置方式参考 配置 LLM 服务。

配置入口

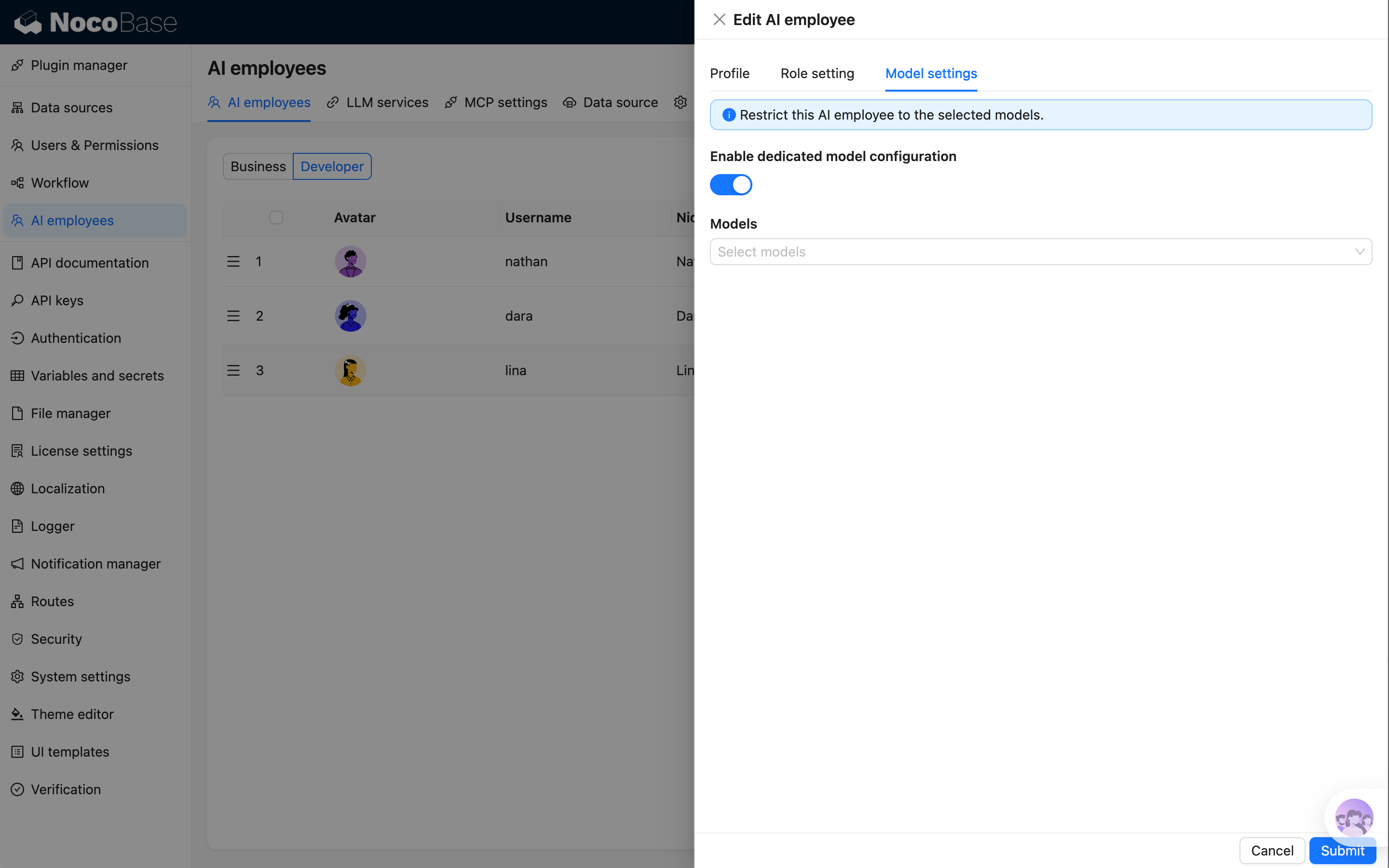

进入 系统设置 -> AI 员工 -> AI employees,打开需要配置的 AI 员工详情,切换到 Model settings。

在该页面中可以启用或关闭当前员工的专用模型配置。

启用专用模型配置

打开 Enable dedicated model configuration 后,可以在 Models 中选择该 AI 员工允许使用的模型。

支持选择多个模型。可选模型来自已启用的 LLM 服务及其 Enabled Models。

启用后,该 AI 员工只能使用这里选择的模型:

- 聊天窗口中的模型切换器只展示已选择的模型。

- 快捷任务只能使用已选择的模型。

- 工作流 AI 员工节点只能选择已选择的模型。

- 如果调用时传入了不在允许范围内的模型,系统会自动使用允许范围内的第一个模型。

如果开启了专用模型配置,但没有选择任何模型,该 AI 员工将无法解析可用模型,使用时会提示模型未配置。

关闭专用模型配置

关闭 Enable dedicated model configuration 后,该 AI 员工会回到默认模型规则:

- 可以使用所有已启用的 LLM 服务模型。

- 用户在聊天中可以切换到任意可用模型。

- 如果没有手动选择模型,系统会使用全局默认模型。

模型解析规则

AI 员工执行任务时,会按以下顺序确定最终使用的模型:

- 如果该员工启用了专用模型配置,优先在已选择的模型范围内解析。

- 如果调用时指定了模型,并且该模型在允许范围内,则使用指定模型。

- 如果指定模型不在允许范围内,则使用允许范围内的第一个模型。

- 如果该员工未启用专用模型配置,则优先使用调用时指定的模型。

- 如果没有指定模型,则使用系统全局默认模型。

使用建议

- 为专项员工配置更匹配的模型。例如翻译、本地化、数据分析、代码生成等场景,可以使用不同模型。

- 为成本敏感场景选择较低成本模型,并限制用户切换到高成本模型。

- 为需要工具调用、联网搜索或结构化输出的员工,选择支持对应能力的模型。

- 为内置关键员工保留至少一个稳定可用的模型,避免任务运行时无模型可用。

常见问题

为什么模型列表为空?

通常是因为还没有配置 LLM 服务,或 LLM 服务中没有启用任何模型。请先检查 LLM service 中的 Enabled Models。

为什么用户不能切换到其它模型?

如果该 AI 员工启用了专用模型配置,聊天窗口只允许在所选模型范围内切换。需要使用其它模型时,可以在 Model settings 中补充模型,或关闭专用模型配置。

修改模型配置后会影响哪些入口?

会影响该 AI 员工后续发起的聊天、快捷任务、工作流 AI 员工节点和插件内置任务。已完成的历史消息不会重新生成。