Уведомление об ИИ-переводе

Этот документ был переведён с помощью ИИ. Для получения точной информации обратитесь к английской версии.

Настройка LLM-сервиса

Перед использованием AI-сотрудников необходимо настроить доступные LLM-сервисы.

На данный момент поддерживаются OpenAI, Gemini, Claude, DeepSeek, Qwen, Kimi, а также локальные модели Ollama.

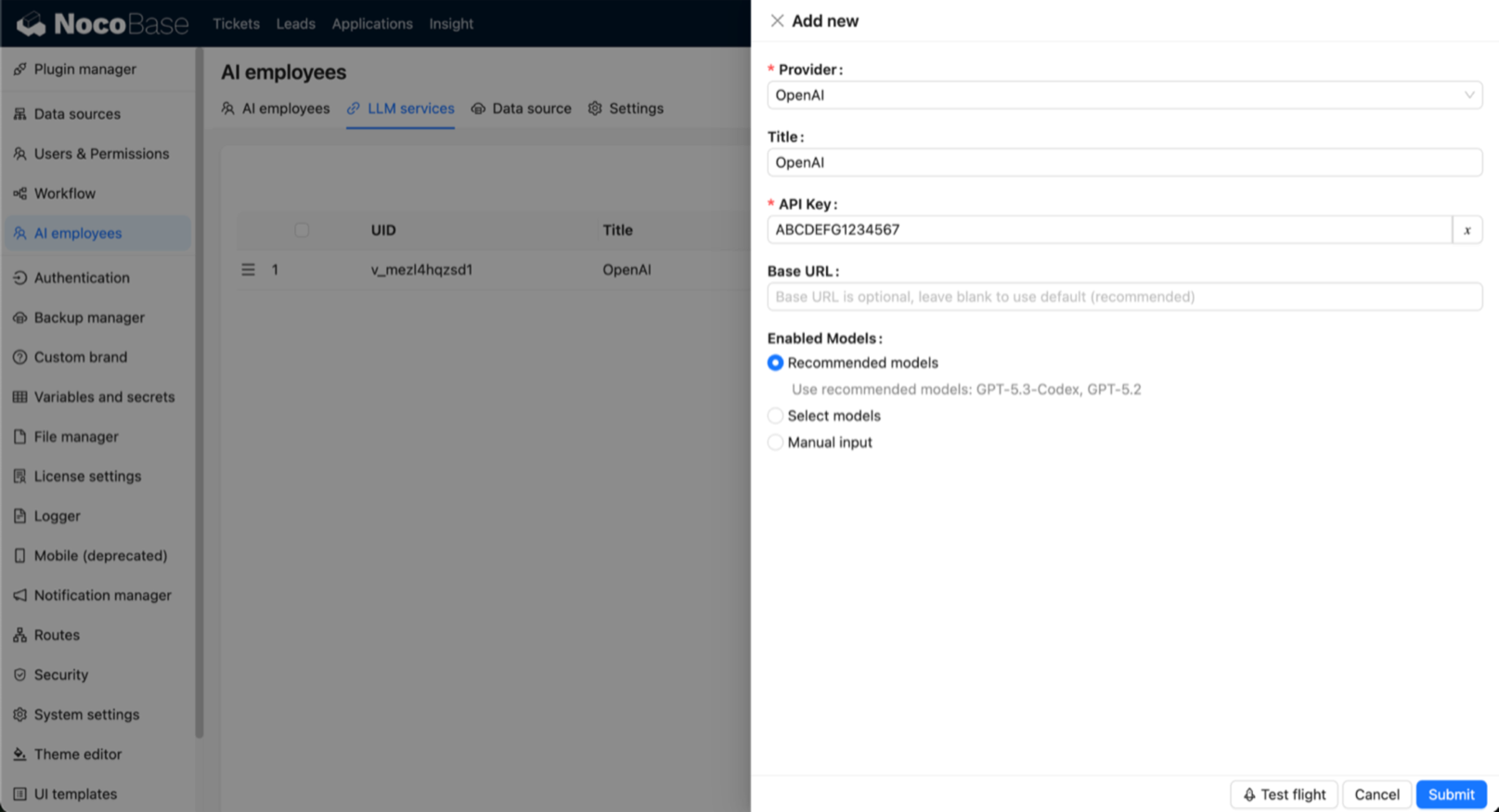

Создание сервиса

Перейдите в Настройки системы -> AI-сотрудники -> LLM-сервис.

- Нажмите

Add New, чтобы открыть окно создания. - Выберите

Provider(Провайдера). - Заполните

Title(Название),API KeyиBase URL(необязательно). - Настройте

Enabled Models(Включенные модели):Recommended models: использовать официально рекомендованные модели.Select models: выбрать модели из списка, п�редоставленного провайдером.Manual input: вручную ввести ID модели и отображаемое имя.

- Нажмите

Submit, чтобы сохранить изменения.

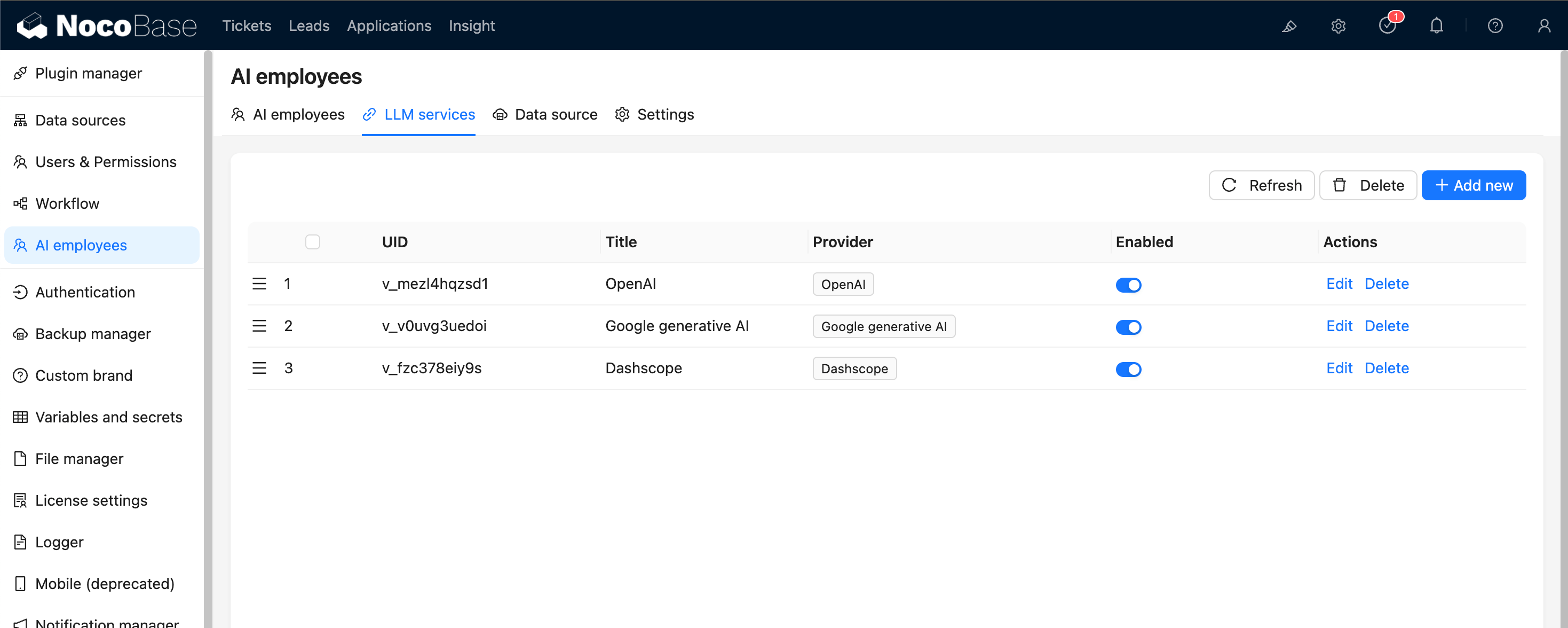

Включение и сортировка сервисов

В списке LLM-сервисов вы можете:

- Использовать переключатель

Enabledдля включения или выключения сервиса. - Перетаскивать сервисы для изменения их порядка (это влияет на порядок отображения моделей).

Проверка доступности

Используйте кнопку Test flight в нижней части окна конфигурации сервиса, чтобы проверить доступность сервиса и моделей.

Рекомендуется сначала провести тест, прежде чем использовать сервис в рабочих процессах.