Aviso de traducción IA

Este documento ha sido traducido por IA. Para información precisa, consulte la versión en inglés.

Configurar el servicio LLM

Antes de utilizar los Empleados de IA, debe configurar los servicios LLM disponibles.

Actualmente se admiten OpenAI, Gemini, Claude, DeepSeek, Qwen, Kimi y modelos locales de Ollama.

Crear servicio

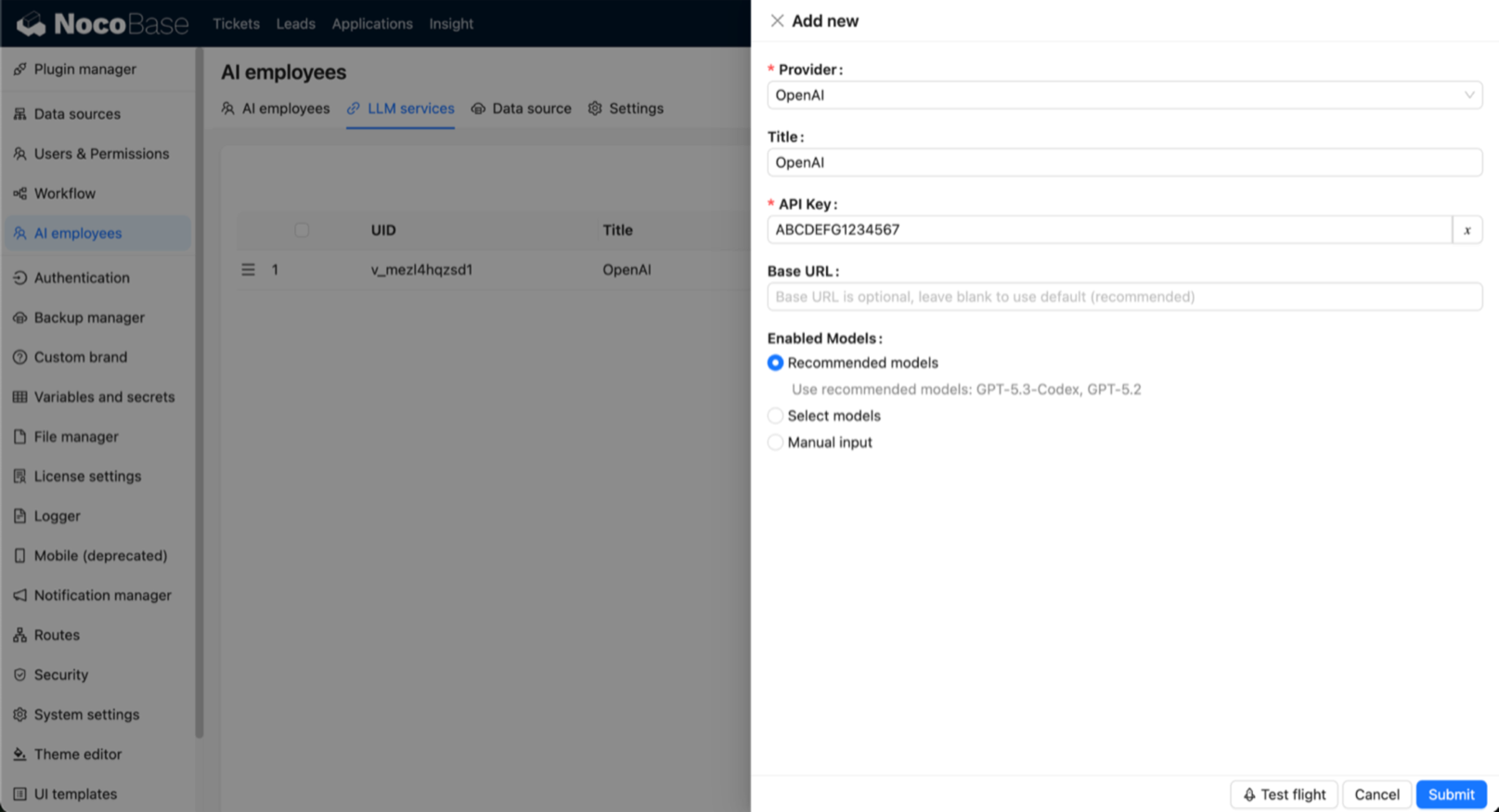

Diríjase a Configuración del sistema -> Empleados de IA -> Servicio LLM.

- Haga clic en

Add Newpara abrir el cuadro de diálogo de creación. - Seleccione el

Provider(Proveedor). - Complete el

Title(Título), laAPI Keyy laBase URL(opcional). - Configure los

Enabled Models(Modelos habilitados):Recommended models: utilice los modelos recomendados oficialmente.Select models: seleccione de la lista devuelta por el proveedor.Manual input: ingrese manualmente el ID del modelo y el nombre a mostrar.

- Haga clic en

Submitpara guardar.

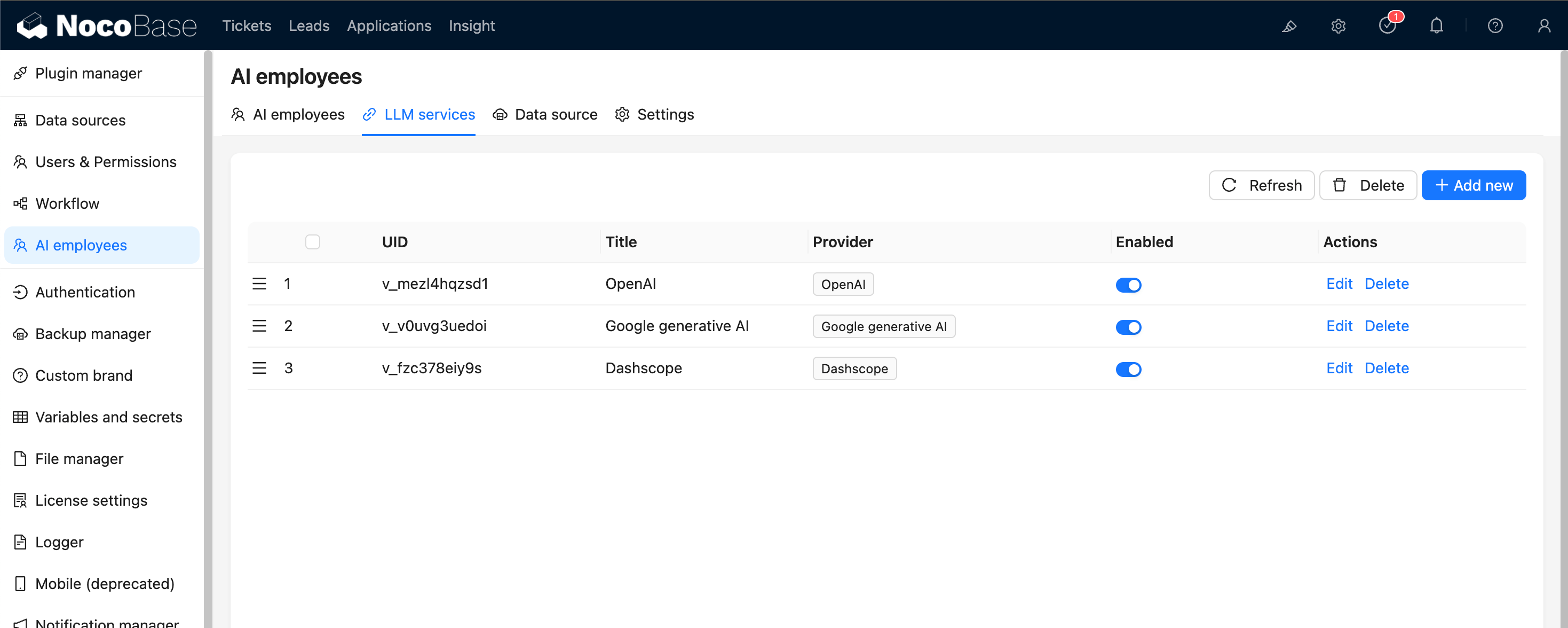

Habilitación y ordenación de servicios

En la lista de servicios LLM, puede directamente:

- Utilizar el interruptor

Enabledpara activar o desactivar el servicio. - Arrastrar para reordenar los servicios (esto afecta el orden de visualización de los modelos).

Prueba de disponibilidad

Utilice Test flight en la parte inferior del cuadro de diálogo de configuración para verificar la disponibilidad del servicio y del modelo.

Se recomienda realizar esta prueba antes de poner el servicio en producción.