KI-Übersetzungshinweis

Dieses Dokument wurde von KI übersetzt. Für genaue Informationen lesen Sie bitte die englische Version.

LLM-Dienst konfigurieren

Bevor Sie AI-Mitarbeiter verwenden, müssen Sie zunächst die verfügbaren LLM-Dienste konfigurieren.

Derzeit werden OpenAI, Gemini, Claude, DeepSeek, Qwen, Kimi sowie lokale Ollama-Modelle unterstützt.

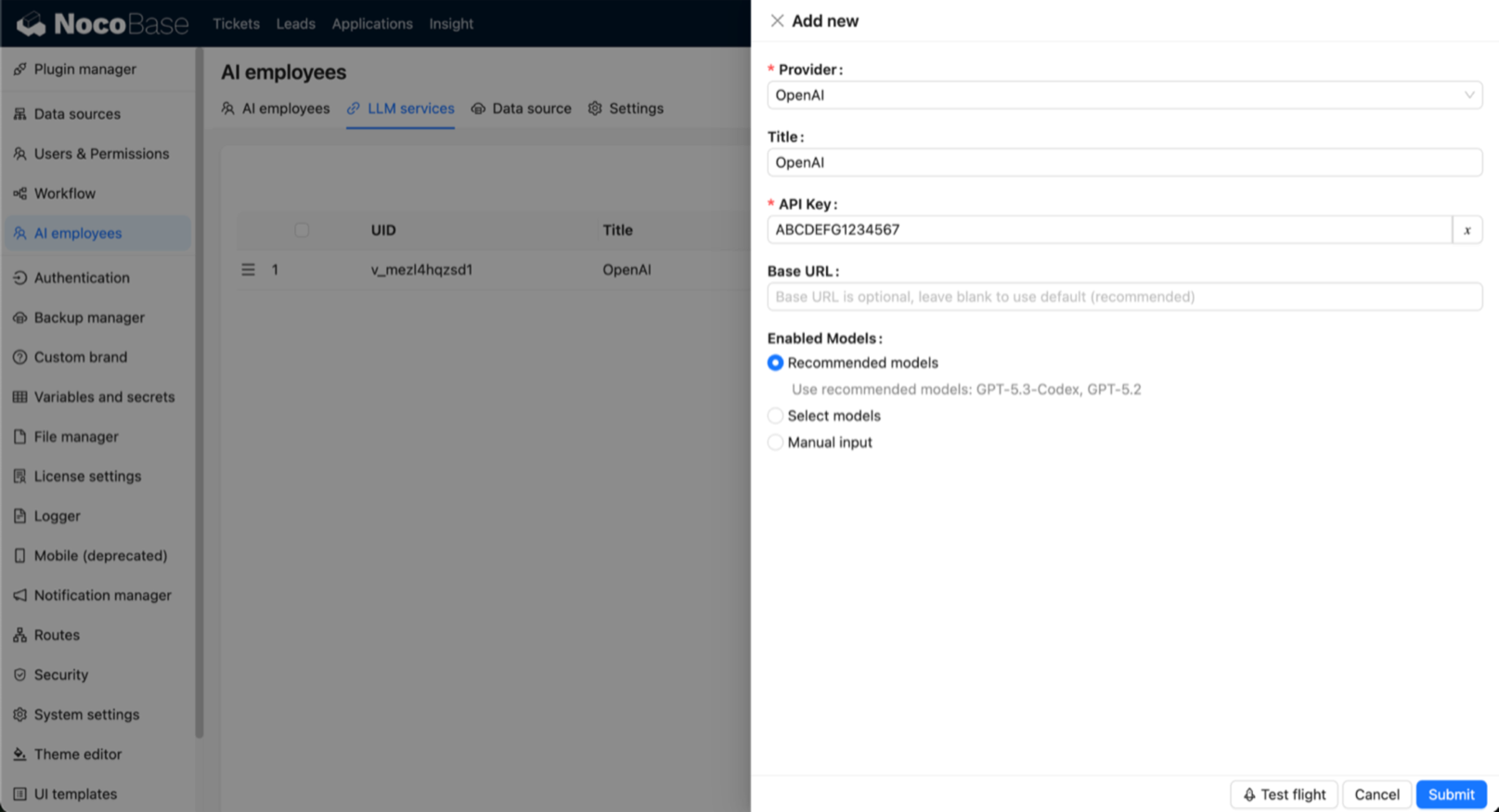

Neuen Dienst erstellen

Gehen Sie zu Systemeinstellungen -> AI-Mitarbeiter -> LLM-Dienst.

- Klicken Sie auf

Neu hinzufügen, um das Erstellungsfenster zu öffnen. - Wählen Sie den

Anbieteraus. - Geben Sie

Titel,API-SchlüsselundBasis-URL(optional) ein. - Konfigurieren Sie die

Aktivierten Modelle:Empfohlene Modelle: Verwendung der offiziell empfohlenen Modelle.Modelle auswählen: Auswahl aus der vom Anbieter bereitgestellten Liste.Manuelle Eingabe: Manuelle Eingabe der Modell-ID und des Anzeigenamens.

- Klicken Sie auf

Absenden, um zu speichern.

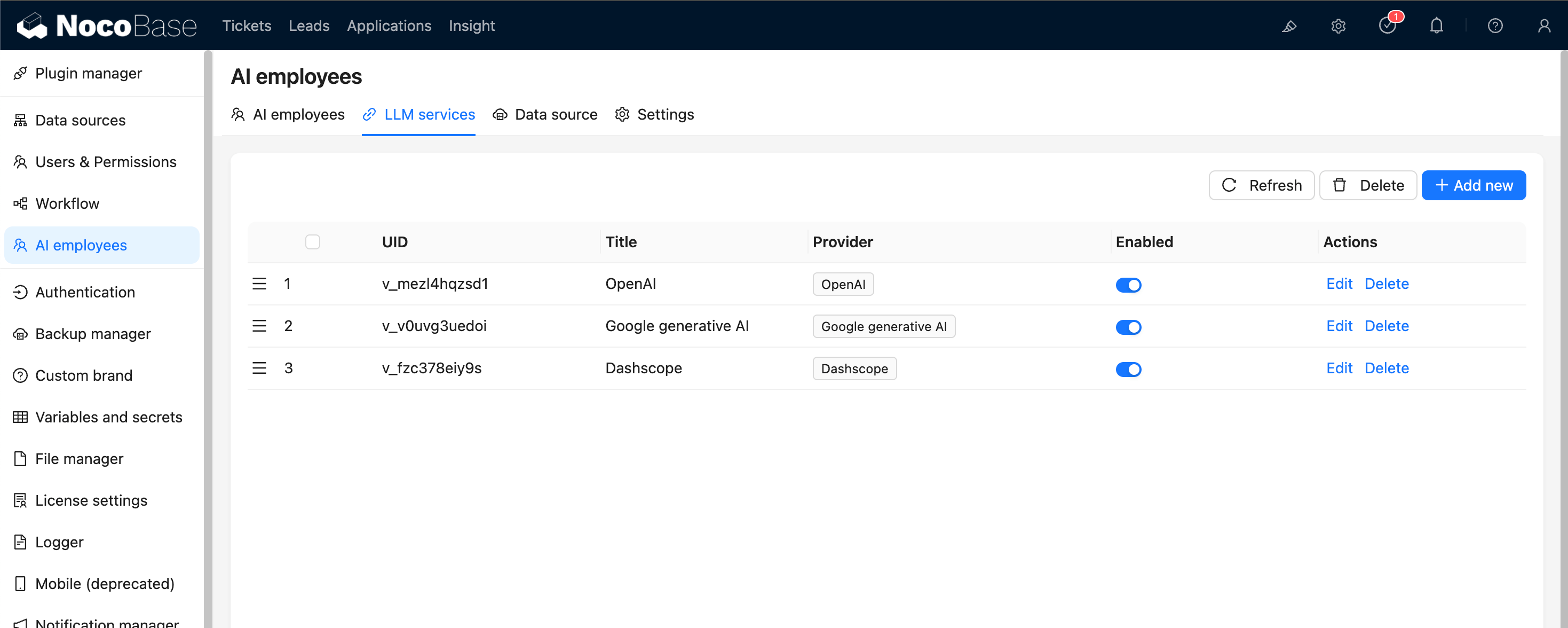

Dienste aktivieren und sortieren

In der Liste der LLM-Dienste können Sie direkt:

- Den Schalter

Aktiviertverwenden, um Dienste zu starten oder zu stoppen. - Die Reihenfolge der Dienste per Drag-and-Drop verschieben (dies beeinflusst die Anzeigereihenfolge der Modelle).

Verfügbarkeitstest

Verwenden Sie Testflug am Ende des Konfigurationsfensters, um die Verfügbarkeit des Dienstes und der Modelle zu prüfen.

Es wird empfohlen, diesen Test durchzuführen, bevor Sie den Dienst im Geschäftsbetrieb einsetzen.