Avis de traduction IA

Ce document a été traduit par IA. Pour des informations précises, veuillez consulter la version anglaise.

Configurer le service LLM

Avant d'utiliser les Employés AI, vous devez d'abord configurer les services LLM disponibles.

Les fournisseurs pris en charge incluent OpenAI, Gemini, Claude, DeepSeek, Qwen, Kimi, ainsi que les modèles locaux Ollama.

Créer un service

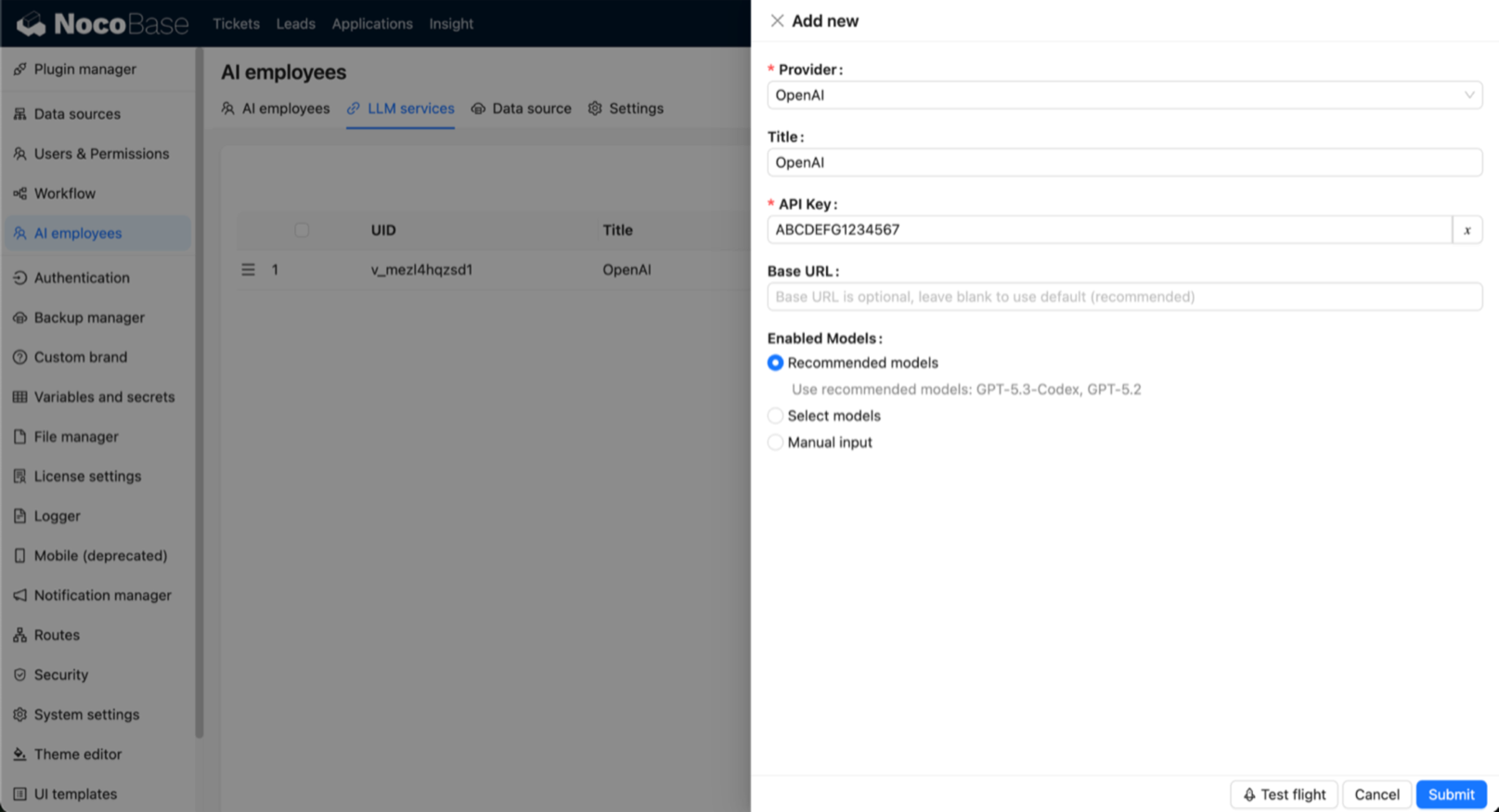

Accédez à Paramètres du système -> Employés AI -> LLM service.

- Cliquez sur

Add Newpour ouvrir la fenêtre de création. - Sélectionnez le

Provider. - Remplissez le

Title, l'API Keyet l'Base URL(facultatif). - Configurez les

Enabled Models:Recommended models: utiliser les modèles recommandés officiellement.Select models: sélectionner dans la liste retournée par le fournisseur.Manual input: saisir manuellement l'ID du modèle et son nom d'affichage.

- Cliquez sur

Submitpour enregistrer.

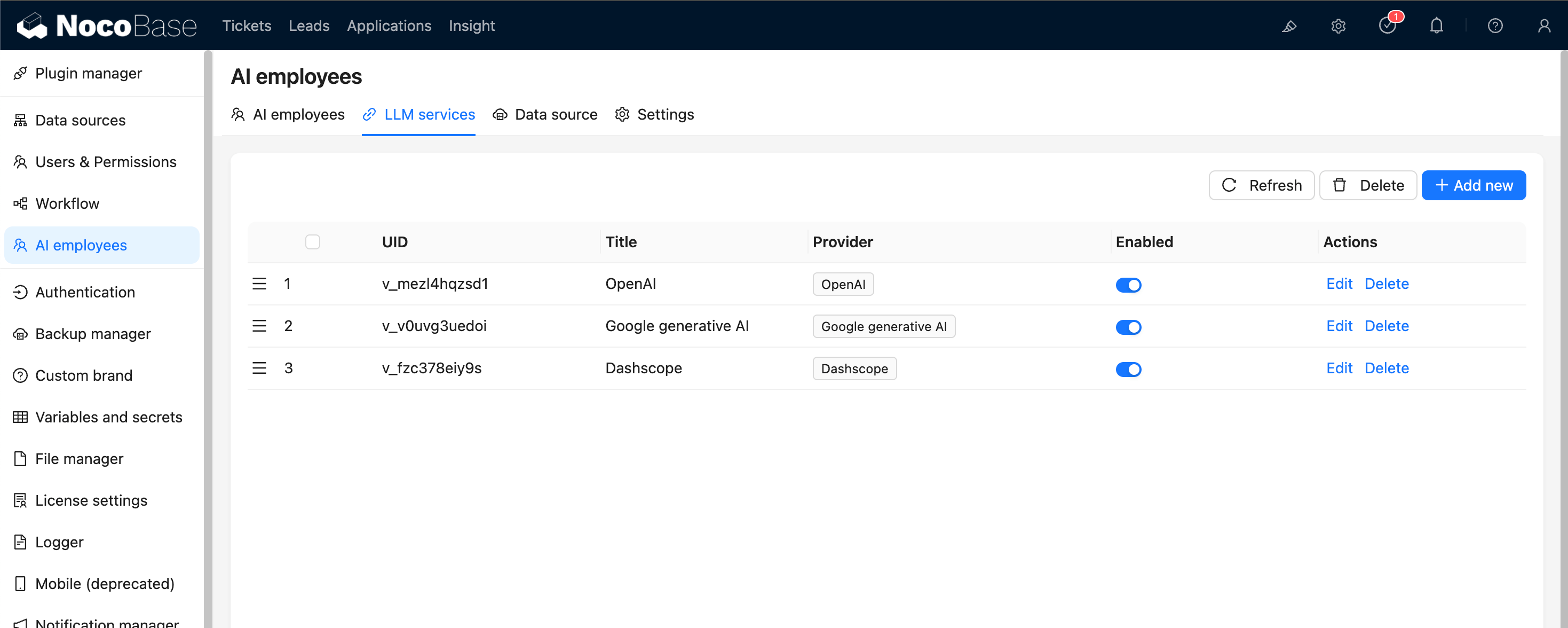

Activation et tri des services

Dans la liste des services LLM, vous pouvez directement :

- Utiliser l'interrupteur

Enabledpour activer ou désactiver un service. - Faire glisser pour réorganiser l'ordre des services (ceci affecte l'ordre d'affichage des modèles).

Test de disponibilité

Utilisez Test flight au bas de la fenêtre de configuration du service pour vérifier la disponibilité du service et des modèles.

Il est recommandé de tester le service avant de l'utiliser en production.