Aviso de tradução por IA

Este documento foi traduzido por IA. Para informações precisas, consulte a versão em inglês.

Configurar serviço de LLM

Antes de usar os Funcionários de IA (AI Employees), você precisa configurar os serviços de LLM disponíveis.

Atualmente, são suportados OpenAI, Gemini, Claude, DeepSeek, Qwen, Kimi e modelos locais do Ollama.

Criar serviço

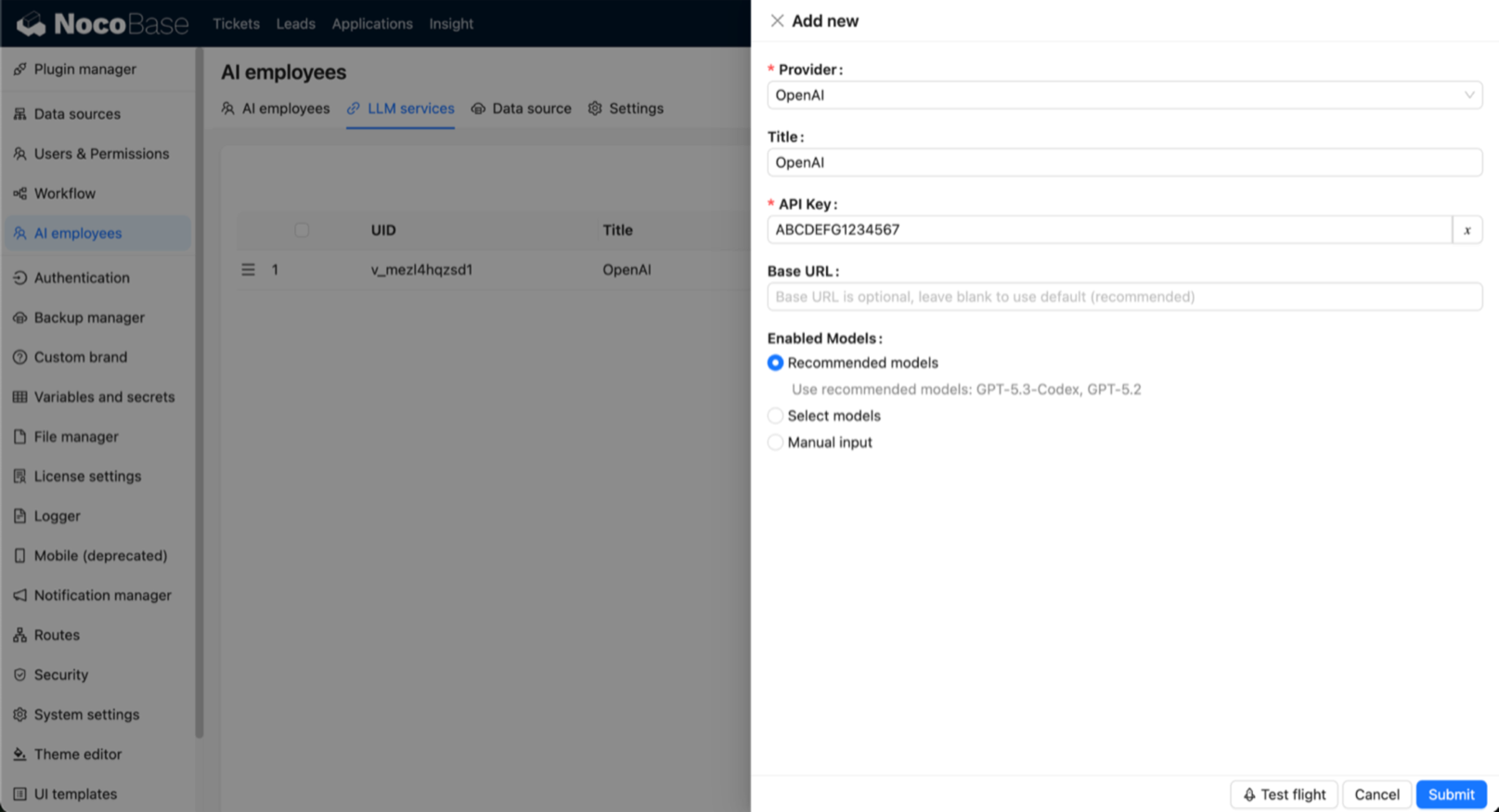

Acesse Configurações do sistema -> AI Employees -> LLM service.

- Clique em

Add Newpara abrir a janela de criação. - Selecione o

Provider(Provedor). - Preencha o

Title(Título),API KeyeBase URL(opcional). - Configure os

Enabled Models(Modelos habilitados):Recommended models: usa os modelos recomendados oficialmente.Select models: seleciona a partir da lista retornada pelo provedor.Manual input: insira manualmente o ID do modelo e o nome de exibição.

- Clique em

Submitpara salvar.

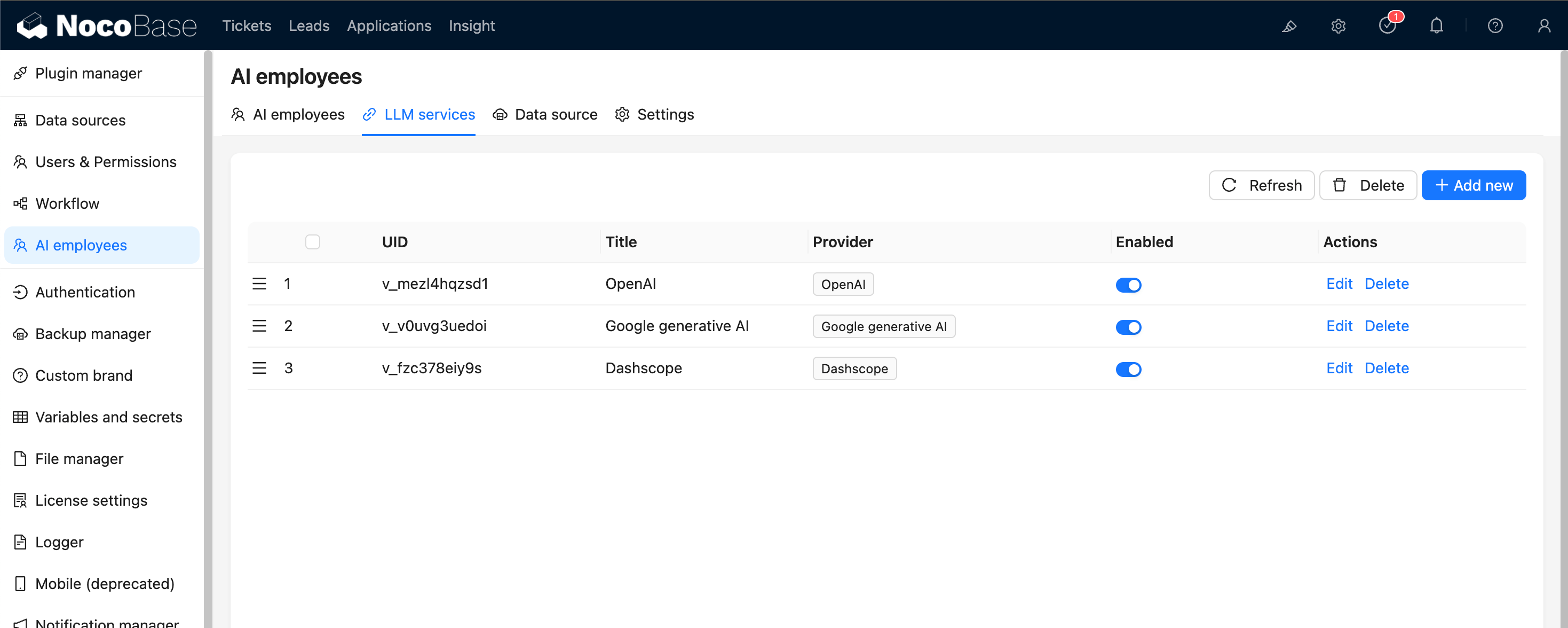

Habilitação e ordenação de serviços

Na lista de serviços de LLM, você pode:

- Usar a chave

Enabledpara ativar ou desativar o serviço. - Arrastar para reordenar os serviços (isso afeta a ordem de exibição dos modelos).

Teste de disponibilidade

Use o botão Test flight na parte inferior da janela de configuração para verificar a disponibilidade do serviço e do modelo.

Recomenda-se realizar o teste antes de colocar o serviço em uso na produção.